Хотя уже существуют системы ИИ, которые генерируют звуковые эффекты, соответствующие безмолвным изображениям городских улиц, экспериментальная новая технология делает прямо противоположное. Она генерирует изображения, соответствующие аудиозаписям улиц, с поразительной точностью.

Разработанная доцентом Юхао Кангом и его коллегами из Техасского университета в Остине, «Модель диффузии звукового ландшафта в изображение» была обучена на наборе данных из 10-секундных аудиовизуальных клипов.

Эти клипы состояли из неподвижных изображений и окружающего звука, взятых из видеороликов YouTube городских и сельских улиц Северной Америки, Азии и Европы. Используя алгоритмы глубокого обучения, система узнала не только, какие звуки соответствуют каким элементам на изображениях, но и какие звуковые качества соответствуют каким визуальным средам.

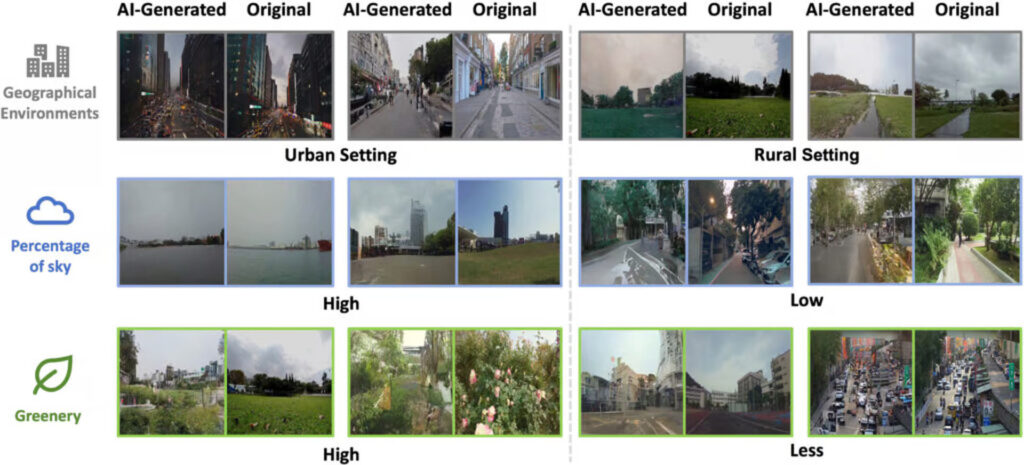

После завершения обучения системе было поручено генерировать изображения исключительно на основе записанного окружающего звука из 100 других видеороликов с видом на улицу — для каждого видеоролика создавалось одно изображение.

Затем группе судей-людей было показано каждое из этих изображений вместе с двумя сгенерированными изображениями других улиц, при этом прослушивался видеосаундтрек, на котором основывалось изображение. Когда их попросили определить, какое из трех изображений соответствует саундтреку, они в среднем дали 80% точных ответов.

Более того, при компьютерном анализе полученных изображений было обнаружено, что относительные пропорции открытого неба, зелени и зданий сильно коррелируют с соответствующими показателями в исходных видеороликах.

Фактически, во многих случаях сгенерированные изображения также отражали условия освещения исходных видео, такие как солнечное, облачное или ночное небо. Это могло быть возможным благодаря таким факторам, как снижение шума от транспорта ночью или звуки ночных насекомых.

Хотя эта технология может найти применение в криминалистике, например, для получения приблизительного представления о том, где была сделана аудиозапись, исследование в большей степени направлено на изучение того, как звук влияет на наше чувство места.

«Результаты могут расширить наши знания о влиянии зрительного и слухового восприятия на психическое здоровье человека, могут послужить руководством для разработки методов городского проектирования при организации пространства и могут улучшить общее качество жизни в сообществах», — утверждают ученые в статье, недавно опубликованной в журнале Nature.

Источник: New Atlas

Перевод с английского

Читайте также:

Google AI учится говорить по-дельфиньи

Прототип летающего автомобиля с бочкообразным ротором начинает летные испытания

Инновационный «вечный блокнот» — золотая середина между цифровыми и бумажными носителями

Coffee Time journal

Твой журнал на каждый день!